범용 근사 정리와 ReLU의 기하학

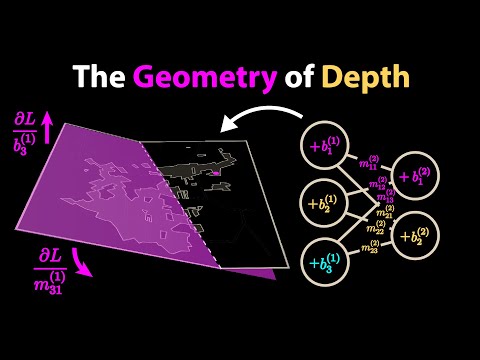

1989년 조지 사베노가 증명한 범용 근사 정리는 적절한 뉴런을 가진 2층 신경망이 우리가 원하는 어떤 복잡한 함수(예: 복잡한 국경선)도 근사할 수 있음을 보장함. 현대 신경망에서 주로 사용하는 ReLU(Rectified Linear Unit) 활성화 함수는 기하학적으로 입력 평면을 특정 선을 따라 접는 역할을 함. 첫 번째 층의 뉴런들이 평면을 접고, 두 번째 층이 이들을 조합하여 복잡한 표면을 만들어내며, 이 표면들의 교차점이 최종적인 결정 경계가 됨.

넓은 모델의 한계와 깊은 모델의 승리

이론적으로는 뉴런 수만 늘리면 2층 신경망으로도 충분해야 하지만, 실제 실험 결과 10만 개의 뉴런을 사용해도 복잡한 국경선을 완벽히 학습하지 못함. 이는 범용 근사 정리가 솔루션의 존재만 증명할 뿐, 경사 하강법으로 그 솔루션을 찾을 수 있는지나 필요한 뉴런의 효율성을 보장하지 않기 때문임. 반면, 단 130개의 뉴런을 5개 층으로 나누어 배치한 모델은 10만 개 뉴런 모델보다 훨씬 정밀하게 경계를 찾아냄.

층이 쌓일 때 발생하는 기하학적 복합성

깊은 모델이 강력한 이유는 연산의 중첩(Compounding)에 있음. 첫 번째 층이 평면을 접으면, 두 번째 층은 이미 접힌 표면을 다시 접음. 이 과정에서 새로운 접힘 선은 이전 층의 결과에 따라 굴절되며 훨씬 복잡한 다각형 영역을 생성함. 수학적으로 얕은 네트워크의 영역 분할 능력은 뉴런 수에 따라 다항식으로 증가하지만, 깊은 네트워크는 층의 수에 따라 지수함수적으로 증가함.

0

검열관 메모 (0)

아직 검열관 메모가 없습니다. 첫 번째 메모를 남겨보세요.